Was ist künstliche Intelligenz? – Ein Abriss

Künstliche Intelligenz (KI) gewinnt zunehmend an Relevanz. Gründe sind die steigende Verfügbarkeit und Menge an Daten bei zugleich sinkenden Kosten der benötigten Rechenleistung. Maßgebliche Technologietreiber und Finanzförderer waren anfangs die Werbeindustrie (Personalisierung in der digitalen Welt) und der Verteidigungssektor (autonome Systeme im militärischen Bereich).

Wesentlicher Aspekt für die KI im industriellen Kontext ist das „Lernen“. Dies bedeutet, aus bekannten bzw. erlernten Lösungswegen selbstständig auf die Lösung bisher neuartiger bzw. unbekannter Probleme zu schließen (erlernte Strategie). Die Idee der vollständigen Nachahmung menschlicher Intelligenz in allen Facetten (das Feld der sogenannten Artificial General Intelligence – AGI) lassen wir im Folgenden außen vor.

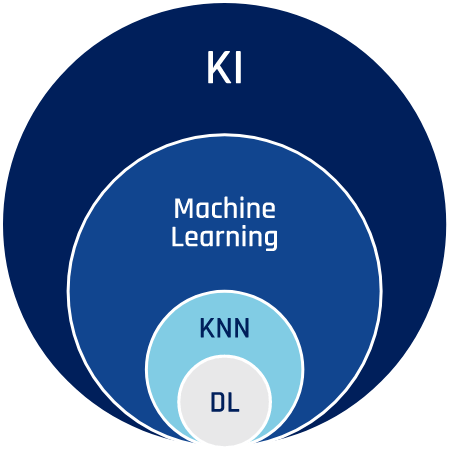

Das dem Erlernen zugewandte KI-Teilgebiet nennt sich Machine Learning (ML). Dem ML entstammen Unterbegriffe wie künstliche neuronale Netze (KNNs), wiederum samt Teilgebieten wie dem Deep Learning (DL). Nicht nur verschiedene ML-Strukturen, sondern auch die Zielsetzung und das Training – ob überwacht (Zuordnungen vorgegeben) oder unüberwacht bzw. verstärkend – sind dabei sehr variant.

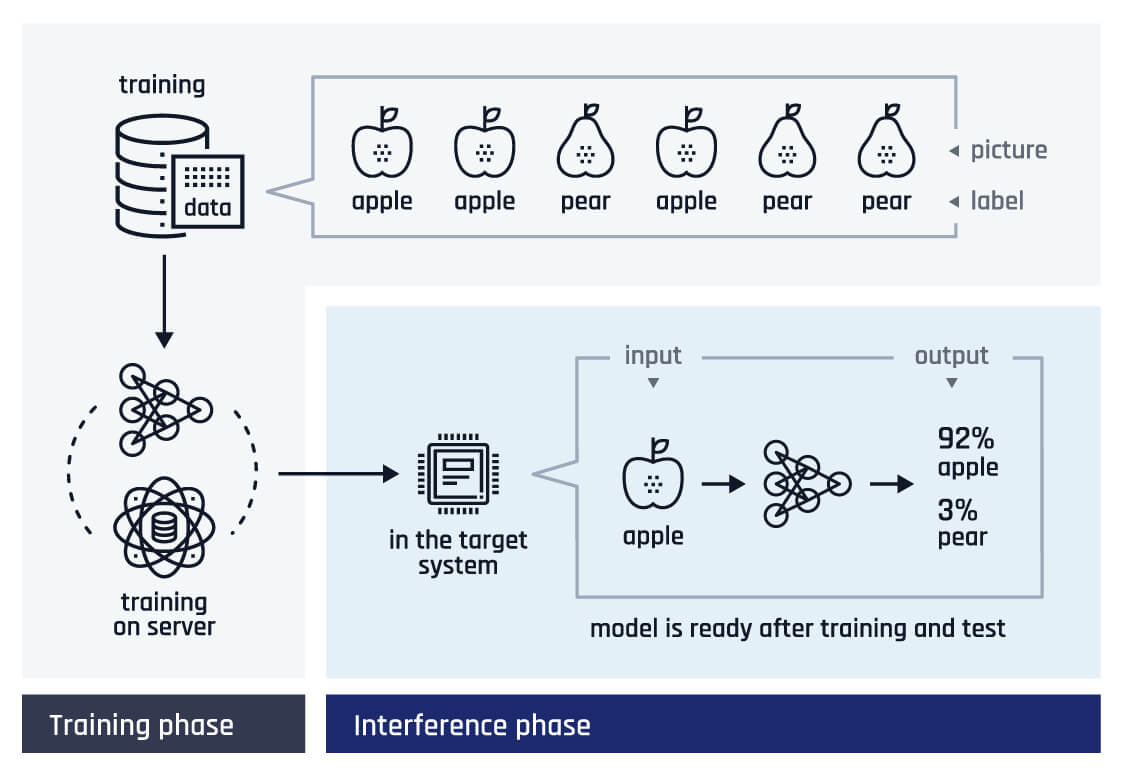

Mit Machine Learning ist man in der Lage, sehr zuverlässig, robust und effizient Anomalien, Bildinhalte, Sprache, Texte, technische Zusammenhänge und Ähnliches zu erkennen und einzuordnen bzw. (unbekannte) Zusammenhänge zu nutzen. Dies wird im medialen Bereich auch mit Mustererkennung umschrieben. Im einfachsten Fall erstellt ein neuronales Netz eine Abbildung (ein Modell) aus einer Eingabe (ein Bild eines Apfels) zu einer Ausgabe (Objekt: Apfel – Wahrscheinlichkeit 92 %, Objekt: Birne – Wahrscheinlichkeit 3 % usw.). Diese Zuordnung funktioniert im besten Fall auch, wenn der (beispielhaft verwendete) Apfel andersfarben, angebissen oder verwaschen ist oder auf dem Kopf steht. In vielen spezifisch eingegrenzten Aufgabenstellungen ist die Technologie der menschlichen Fähigkeit voraus.

Die passenden ML-Modelle müssen anfangs auf die entsprechende Aufgabe trainiert werden. Das Training solcher Strukturen beruht üblicherweise auf großen, aufbereiteten und selektierten Datenmengen und geschieht auf speziellen Servern, die meist durch GPUs oder FPGAs entsprechend notwendige Parallelisierung bieten. Im trainierten Zustand können die Systeme dann auf die Endanwendung übertragen werden. Eine große Herausforderung ist dabei immer, die (vor)trainierten Algorithmen auf Systemen mit wenigen Ressourcen ohne drastische Leistungseinbußen „herunterzubrechen“. Genau das ist bei Embedded-Systemen und folglich auch bei den autonomen Steuerungssystemen stets der Anspruch und erfordert die notwendige technologische Kompetenz.

Für die Einschätzung der Wirksamkeit und des Nutzens von Machine Learning ist das folgende Verständnis zentral: ML-Tools sind als Werkzeuge zu verstehen, die in der Praxis für spezifische Problemstellungen verwendet werden. Der Rest des Systems oder des Prozesses bleibt von der KI unberührt. Folglich entstehen Kombinationen aus bestehenden Systemkomponenten und ML-Tools – sogenannte Hybridsysteme. Aus diesem Grund dürfen ML-Tools nicht separat, sondern müssen immer im Gesamten betrachtet werden.

Machine-Learning-Algorithmen führen zu Leistungssteigerungen in vielen Aufgabenbereichen. Diese Zunahme ist nicht mehr Folge der bisher stets gewachsenen Transistorenanzahl (Ursprung vom mooreschen Gesetz), sondern liegt in der Art und Weise begründet, wie die (probabilistischen) Systeme im Hintergrund erkennen, entscheiden und handeln.

Gerade bei ML-Algorithmen wie den KNNs ist es durch ihre Architektur und ihre Komplexität sehr schwer, konkrete Ausgaben aus den Eingabeinformationen abzuleiten (d. h. das Verhalten vorherzusagen) oder auf Basis einer Ausgabe die konkreten Entscheidungsmerkmale aufzubereiten. Im Allgemeinen wird dieses Verhalten mit dem Bild einer Black Box umschrieben. Zum Zweck größerer Transparenz, die insbesondere auch für die Akzeptanz des autonomen Fahrens entscheidend ist, entstanden daher (empirische) Forschungsgebiete wie das der Explainable AI.

In den kommenden Jahren wird es im Machine-Learning-Bereich viele Leistungssprünge durch Technologieumbrüche geben – sei es durch Memristor-Arrays, Spiking Neural Networks, Distributed Training, optische Netzwerke oder Turing-unvollständige Architekturansätze. Damit wird es möglich, immer komplexere Aufgaben vor Ort bzw. auf der Maschine zu lösen. Wir freuen uns auf die positiven und umfangreichen Auswirkungen auf unsere geschäftliche Kernkompetenz!